12月24日,第五届中国模式识别与计算机视觉大会(PRCV 2022)在深圳隆重开幕。在当日举办的竞赛专题分会现场,组委会宣布了此次大会各项专题赛获奖名单,其中,在空地智能无人系统环境感知挑战赛中,湖南大学无锡智能控制研究院定位团队凭借出色的方案解决能力,夺得多传感器融合SLAM赛道冠军!

图一:无锡院定位团队获得多传感器融合SLAM赛道冠军

本届空地智能无人系统环境感知挑战赛依托于国内顶级的模式识别和计算机视觉领域学术盛会——PRCV 2022举行,共设置了无人机视角下的目标检测、无人机视角下的双光人群计数、多传感器融合SLAM三个赛道。湖南大学无锡智能控制研究院定位团队参与了多传感器融合SLAM赛道比赛。

图二:荣誉证书

1.多传感器融合SLAM赛题解析

赛道三任务为多传感器融合SLAM,实时定位与地图构建(Simultaneous Localization and Mapping,SLAM)是指在没有周围环境先验信息的前提下,智能运载设备仅依赖携带传感器的信息,完成自身位姿估计与环境地图构建的过程,它是保障智能运载设备决策、规划等模块正常运行的重要前提。相较于激光雷达SLAM,以相机为主导的视觉SLAM由于价格低廉、功耗小、色彩纹理信息丰富等优势受到了广泛关注。不过,虽然近些年来基于特征的方法和基于光流的视觉SLAM方法都取得较大的进展,但设计一套在各种复杂场景下精准且鲁棒的SLAM系统,仍然是一个具有挑战性的课题。

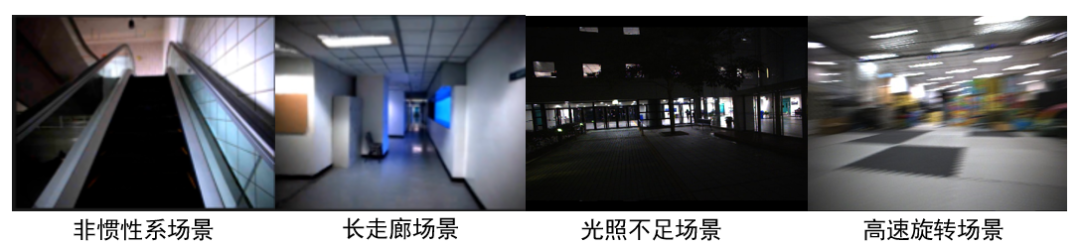

本赛道提供多传感器融合SLAM数据集,旨在融合数据集中的视觉图像(包括传统帧相机和事件相机)、IMU测量来完成机器人的实时定位与地图构建任务。数据集由香港科技大学智能驾驶中心、机器人与多感知实验室RAM-LAB团队收集,包含室内外8种场景17个多传感器数据序列,通过手持、四足机器人和百度阿波罗小车三种平台采集完成。该数据集主要采集于香港科技大学校园内,涵盖多个具有挑战性的场景,如非惯性系、光照不足、高速旋转、长走廊、高动态、长距离等场景。参赛选手需要通过提供的多传感器的数据序列构建VIO算法,生成相应数据序列的定位轨迹。

图三:数据集中部分场景截图

最终,湖南大学无锡智能控制研究院定位技术室团队以1276的优异成绩,夺得该赛道冠军!

2.非理想场景下的视觉惯性SLAM方案分享

在PRCV 2022空地智能无人系统环境感知挑战赛颁奖现场,湖南大学无锡智能控制研究院SLAM技术负责人周云水,向现场嘉宾和专业观众分享了此次团队获奖方案——《非理想场景下的视觉惯性SLAM》。

图四:无锡院SLAM技术负责人分享团队获奖方案

他表示,湖南大学无锡智能控制研究院定位团队针对本次比赛数据集进行了全面的分析,发现主要有两个方面的挑战,分别是多源传感器存在时间延迟且不一致和多种非理想工况下图像数据关联难度高。以下是解决方法:

1.多源传感器时间同步问题

官方虽然利用FPGA接受来自GPS的PPS信号从而统一各传感器时钟源,但由于各异构传感器内部硬件、算法设计实现不同,最终各传感器输出数据的时间延迟也不尽相同。团队利用自研的时间标定算法解决了不同延迟下多源传感器的同步问题,为下一步多源传感器的融合提供前提保障。

2.多种非理想工况下的视觉SLAM算法设计

图三为本次比赛部分场景截图,非惯性场景下相机视野中捕捉到的大部分特征都随相机运动、长走廊环境下纹理的缺失、黑夜中光照不足、高速旋转带来的运动模糊、以及其他诸如光照剧烈变换的场景,都对以图像为主导的SLAM算法的正常运行带来较大考验。

针对非惯性参考系下的特征点随动问题,在原有的SLAM框架基础上,团队利用深度学习训练了一套分割模型,用以剔除落在非惯性参考系下的随动特征点,从而保证剩余图像特征点对于位姿约束的有效性。针对长走廊等稀疏特征场景,团队强化了基于词袋模型的场景重识别模块,以修正局部跟踪失效以及仅依赖IMU导致累计误差问题。针对黑夜环境下的光照不足问题,团队使用传统数字图像处理技术使图像的各灰度级相对均匀分布,从而达到增强图像对比度,还原图像细节的目的。针对高速导致的运动模糊问题,团队通过融合事件相机以及IMU数据完成高速旋转数据集序列中大部分场景的位姿计算与跟踪,考虑到事件相机本身的分辨率以及视场角较小,为保证局部连续帧的定位精度,团队仍借助了场景重识别模块修正相关累计误差。

图五:无锡院SLAM技术负责人现场讲解团队方案

3.未来展望

湖南大学无锡智能控制研究院长期致力于智能运载装备及系统的研发和应用,在融合感知、建图定位、规划控制、调度协同等智能控制技术方向拥有全自主知识产权。SLAM技术是团队关键核心技术之一,目前,团队已在多传感器自动标定、融合建图和定位、动态障碍物剔除等方面开展了深入的研究,并将成果成功应用于自研的多种自主移动机器人中。

此次挑战赛是国内在SLAM领域规模较大、专业性较强的一次比赛,湖南大学无锡智能控制研究院团队在比赛中与行业内很多优秀的团队进行了交流,收获颇多,也更加深刻认识到在部分特殊场景下视觉SLAM的难度。技术创新永无止境,此后还有更多的技术难题需要团队去努力攻克,真正实现“用智能机器人解放枯燥繁重的人类劳动”的使命。

阅读原文:https://mp.weixin.qq.com/s/BcRmfy7JpMZCaUawIYlSmw